Vous avez passé des heures à rédiger un article complet, bien structuré, vraiment utile. Vous l'avez publié. Vous avez attendu....

Agence SEO, GEO & création de sites WordPress à Nantes

Transformez votre présence en performance!

Le Blog!

L’indexation est la première étape de tout référencement naturel. Sans elle, votre contenu n’existe tout simplement pas aux yeux de Google, de Bing etc. Pourtant, c’est l’une des notions les plus mal comprises et les plus sous-estimées par les propriétaires de sites web.

Dans ce guide, je vous explique comment fonctionne le crawl, à quoi sert le fichier robots.txt, comment configurer et analyser Google Search Console, et pourquoi votre site neuf ou votre prestation SEO mettent du temps à porter leurs fruits.

Avant d’indexer une page, Google doit d’abord la crawler, c’est-à-dire l’explorer. Googlebot, le robot d’exploration de Google, parcourt le web en suivant des liens d’une page à l’autre. Il lit le contenu, les balises HTML, les liens internes, les sitemaps, les « plans de site », puis transmet ces données aux serveurs de Google pour analyse.

Le crawl n’est pas continu ni instantané. Google alloue à chaque site un budget de crawl : il détermine combien de pages seront explorées sur une période donnée. Un site lent, mal structuré ou rempli de pages inutiles ou en erreur gaspille ce budget au détriment de vos pages stratégiques.

Une fois crawlée, une page peut être indexée : elle est analysée, évaluée, puis intégrée à l’index de Google. C’est seulement à partir de ce moment qu’elle peut apparaître dans les résultats de recherche.

⚠️ Attention ! Crawlée ne veut pas dire indexée. Google peut crawler une page sans l’indexer si elle est jugée de faible qualité, en doublon, en erreur, ou bloquée par une directive technique.

Le fichier robots.txt est un fichier texte placé à la racine de votre site (ex. : monsite.fr/robots.txt). Il indique aux robots d’exploration quelles parties du site ils sont autorisés ou non à parcourir. Il peut être commun, ou spécifique robot par robot.

C’est votre première ligne de contrôle du crawl. Bien configuré, il protège vos ressources inutiles de l’exploration (pages d’administration, pages de filtres, contenu dupliqué) et préserve le budget de crawl pour vos pages réellement importantes à forte valeur SEO.

Dans le fichier robots.txt :

« User-agent: *

Disallow: /wp-admin/

Disallow: /private/

Allow: /wp-admin/admin-ajax.php

Sitemap: https://monsite.fr/sitemap.xml »

Ce fichier s’adresse à tous les robots (l’étoile « * »), il bloque l’accès à l’administration WordPress, autorise les requêtes AJAX nécessaires au bon fonctionnement du site, et indique l’emplacement du sitemap pour une meilleure compréhension du site par les robots.

Apprenez en plus sur le SEO sur notre page dédiée

Bloquer par inadvertance des pages importantes. C’est l’erreur la plus courante et la plus coûteuse. Un simple Disallow: / mal placé peut désindexer l’ensemble de votre site en quelques semaines. Imaginez la catastrophe de ne plus apparaître du tout dans les recherches de vos prospects!

Confondre robots.txt et noindex. Le robots.txt empêche le crawl, pas l’indexation. Une page bloquée via robots.txt peut rester indexée si Google l’a découverte via un lien externe. Pour exclure une page des résultats, utilisez plutôt la balise <meta name= »robots » content= »noindex »>.

Découvrez comment nous avons réduit de plus de 23 000 pages les pages inutiles dans la Search Console pour un de nos clients, dans notre étude de cas Shopify, première étape pour sa stratégie SEO & GEO!

C’est l’une des questions les plus fréquentes de mes clients : « J’ai publié mon site il y a 2 mois, j’ai du contenu, mais je n’ai aucun trafic. C’est normal? »

Oui, c’est normal, le référencement prend du temps!

Google accorde sa confiance progressivement. Un site neuf part sans historique, sans backlinks, sans signaux d’autorité. Il faut du temps pour que Googlebot l’explore en profondeur, que les pages soient indexées, et que l’algorithme évalue leur pertinence face à la concurrence.

Phase & Délais estimés

Ces délais sont indicatifs et varient fortement selon la taille de votre site, la concurrence sur vos mots-clés, la qualité de votre contenu et votre stratégie de netlinking.

Vous n’avez pas de résultats au bout d’un mois? Ce n’est pas grave, continuez vos efforts!

Même avec un consultant SEO & GEO expérimenté, les résultats ne sont pas immédiats, c’est structurel, pas un défaut de la prestation.

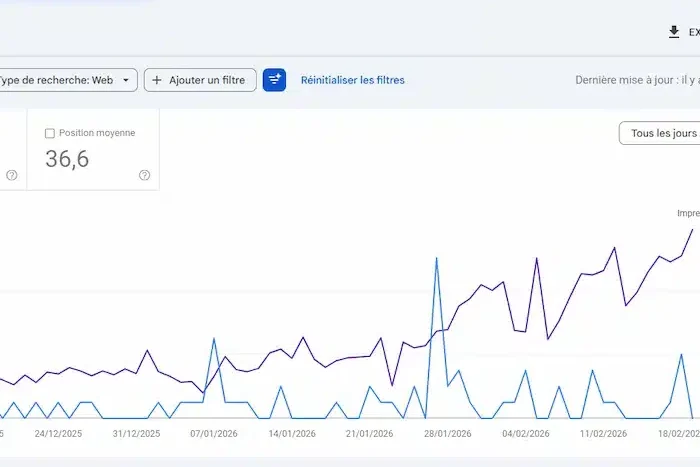

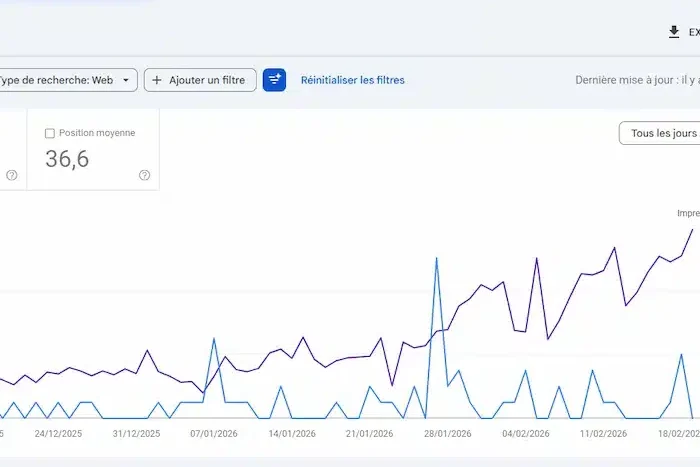

L’optimisation SEO agit sur plusieurs leviers (technique, contenu, autorité) dont les effets sont cumulatifs dans le temps. Google réévalue en permanence les pages, et une amélioration publiée aujourd’hui peut prendre plusieurs semaines à être recrawlée, ré-indexée, et réordonnée dans les SERPs (les pages de résultats de recherches).

Un bon accompagnement SEO s’évalue sur 6 à 12 mois, pas sur 30 jours.

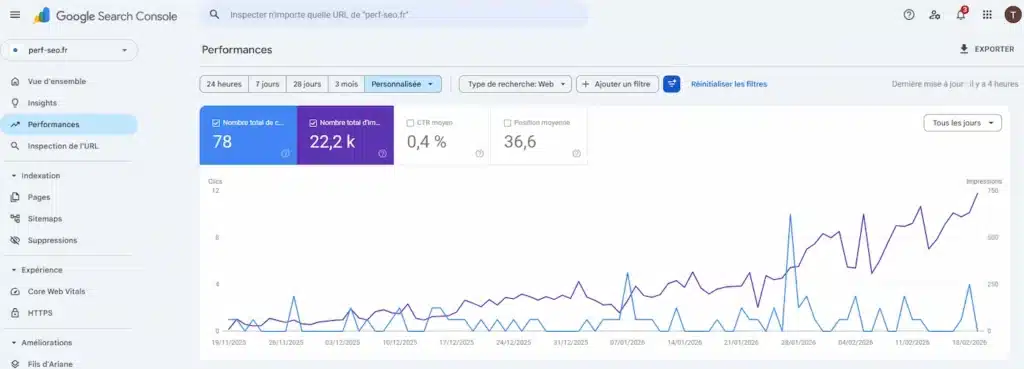

Google Search Console (GSC) est l’outil gratuit de Google qui vous donne une vision directe sur l’état de votre indexation et vos performances dans les résultats de recherche. C’est votre tableau de bord SEO de référence.

C’est le rapport central. Il vous montre :

Vous avez des impressions mais peu de clics? Votre balise title ou meta description n’est pas assez incitative. Travaillez votre SEO, soyez incitatifs, ajoutez des CTA (Call to Action) : « rdv sans engagement », « conseil gratuit », « téléchargez notre livre blanc gratuitement », « découvrez notre nouvelle collection ».

Ce rapport liste les pages indexées et, surtout, celles qui ne le sont pas avec les raisons : page en noindex, erreur 404, contenu dupliqué, redirigé, etc.

Analysez régulièrement les catégories « Exclues » pour identifier des problèmes techniques silencieux qui freinent votre référencement.

Entrez n’importe quelle URL de votre site pour obtenir un diagnostic complet : est-elle indexée? Quand a-t-elle été crawlée pour la dernière fois ? Quelle version Google a-t-il vu? Cet outil est indispensable pour déboguer une page qui ne remonte pas dans les résultats.

Google évalue la vitesse et l’ergonomie de vos pages via les Core Web Vitals (LCP, FCP, INP, CLS). Un mauvais score peut pénaliser votre positionnement. GSC vous indique quelles pages sont en échec et lesquelles nécessitent une attention technique.

Vous voulez en savoir plus sur le SEO? Consultez notre article d’introduction.

Ce rapport analyse vos liens internes (structure de navigation) et vos liens externes (backlinks). Un bon maillage interne améliore la circulation du budget de crawl et le transfert d’autorité entre vos pages. Des liens qui viennent de sites externes reconnus (sites importants, gouvernementaux, presse, bien implantés) vous transmettent de l’autorité, de la visibilité et du trafic.

Les actions prioritaires pour votre indexation

Plusieurs raisons possibles : vos pages ne sont pas encore indexées, elles sont indexées mais mal positionnées sur des requêtes trop concurrentielles, ou votre CTR est faible (title/description peu engageants). Commencez par vérifier l’indexation dans GSC, puis analysez vos positions réelles dans le rapport Performance.

Pour plus d’informations consultez notre article sur l’analyse de contenu ici.

Les pages d’administration, les URL de recherche interne, les pages de panier vides, et tout contenu dupliqué ou à faible valeur SEO. Ne bloquez jamais vos pages de contenu, vos catégories ou vos landing pages.

Le sitemap accélère la découverte, mais ne garantit pas l’indexation. Si une page est exclue, Google la juge souvent trop pauvre en contenu, trop similaire à d’autres, ou elle présente un problème technique (balise noindex, erreur serveur, contenu bloqué).

Oui, dans la majorité des cas. Le SEO est un investissement moyen / long terme. Les premiers résultats visibles (positions, impressions) apparaissent généralement entre 3 et 6 mois. Le trafic qualifié et les conversions suivent dans un second temps.

Vous avez des questions sur l’indexation de votre site ou souhaitez un audit GSC?

Vous avez passé des heures à rédiger un article complet, bien structuré, vraiment utile. Vous l'avez publié. Vous avez attendu....

L'indexation est la première étape de tout référencement naturel. Sans elle, votre contenu n'existe tout simplement pas aux yeux de...

Depuis l’explosion des intelligences artificielles génératives (ChatGPT, Gemini, Perplexity, Claude, Le Chat…), une nouvelle notion est apparue : le GEO...